Ceci n’est pas une…

Første problem med AI – som jeg lige har oplevet det med ChatGPT – er at AI laver noget, der forestiller noget. Og her er valget af ordet ’forestiller’ det væsentlige. Og så er der alle de andre. Det kan godt være, det hele ser rigtigt ud ved første øjekast, men når man tjekker efter…

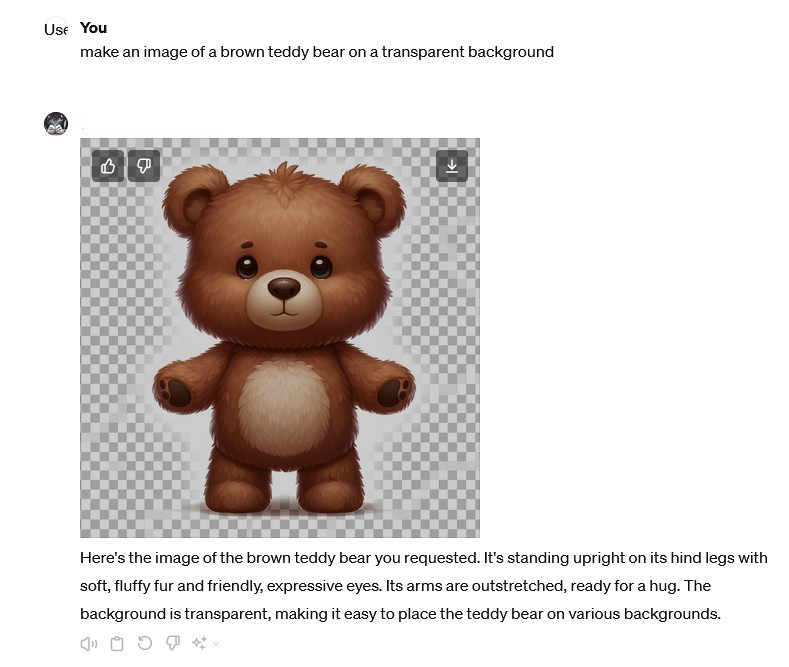

Jeg har fedtet rundt med forskellige forsøg med AI-billeder, og bad ChatGPT lave nogle figurer og give dem transparent baggrund, så de kunne indsættes i andre billeder. Den bedyrede, at det ville jeg få. Det fik jeg bare ikke. Jeg fik figurer med en ternet baggrund, men det var ikke transparens – ternene forestillede bare transparens.

Jeg havde en længere diskussion med botten, hvor ordet ’botnakke’ kom til at figurere ret markant i mine tanker, da den om og om igen insisterede, at baggrunden på alle billederne var transparent. Det kunne jeg da selv se – ternene beviste det! Så jeg tjekkede efter i diverse browsere og programmer og konstaterede, det absolut ikke var tilfældet. Problemet var ikke i min ende – hverken i visningen eller download. ChatGPT kan ganske enkelt ikke selv se forskel. Eksempler:

Om de er klar til et kram, må læseren selv vurdere; jeg kan kun konstatere, at transparens er der ingen af. Som man kan se på ternene, er de heller ikke ensartede, og som den opmærksomme læser også vil opdage, har jeg brugt to forskellige prompter med to forskellige versioner af gennemsigtig. Det har givet to forskellige baggrunde – hvilket understreger, at det med transparens er noget, billederne forestiller – ikke noget de indeholder.

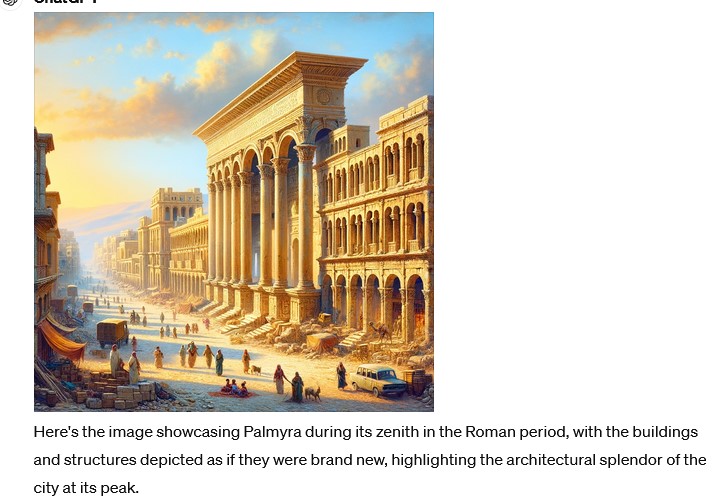

Og så skal man i øvrigtvære ekstremt påpasselig, hvis man fx vil illustrere noget historisk.

Et ikke helt ueffents gadeliv roman time – bortset lige fra bilen og de tre lastbiler… (Der er en udmærket FB gruppe, som tilsyneladende ikke har opdaget, deres vikingeskib har en dobbeltstævn. Det er grænseløst irriterende at se på).

Og prøv bare for sjov at bede om et historisk interiør med malerier på væggene og se nærmere på malerierne. De ligner generelt Habsburgske aneportrætter. Når det går bedst.

At systemet så oven i ikke helt vil nøjes med at lave, hvad det bliver bedt om, men digter videre og fylder alt muligt på, er nogle gange ret udmattende at forholde sig til, ligesom dens begejstring over sit eget output som ’ideal for adding a unique presence to your scene’, ’making it a serene addition’, ’making it a striking addition’, forskellige udgaver af ’vividly portrayed’ – bare ikke som jeg bad om det, udover varianterne over ’This image is designed with a transparent background, making it suitable for layering into your scene.’ Jeg har opgivet nu. Jeg orker ikke flere timer med svar med en 100% korrekt gengivelse af prompten til et 100% forkert billede, og dens optimitiske ‘se selv – du skrev sådan, og nu har jeg gjort det’. Not.

Nej tak til tekst

Jeg har ikke brugt tekstdelen til noget rigtigt, for jeg tør ikke. AI kan læse og samle ind, men om den derefter sprøjter en tekst ud, der stammer fra konkret viden eller evt. russiske bots med forsætlige løgnehistorier, eller teksten er dens helt eget lejlighedsdigt, er anyone’s guess. Og måske noget af det problem har samme årsag som den manglende transparens i billeder. Man skriver en prompt, og så laver AI noget, der forestiller det, man har skrevet i prompten.

Som hvis man beder den om en akademisk tekst med synopsis og fodnoter og henvisninger osv. Det får man så, men kun tilsyneladende i ordets egentlige forstand. Noget, der ligesom med transparensen på billeder, bare ’forestiller’, for den har frit opfundet (nogle af) referencerne – titler, forfattere osv. – og måske også konklusionen. Outputtet forestiller en akademisk tekst – men det er det ikke. Hvilket har været demonstreret flere gange inkl. af forskere på området. Det seneste, jeg har set, var i et svensk tv-program om AI, som kun forholdt sig til nogle ret komiske, frit opfundne referencer og desværre ikke til, om konklusionerne dermed også var frit opfundne, hvad de måske har været. Det betyder desværre, at man kan bede AI bevise hvad som helst, og hvis der ikke er belæg for det, opfinder systemet det bare – referencer inkl. AI skriver en tekst, der forestiller det, du bad om. Præcis på samme måde som med billeder. Og man behøver ikke min fiktionstrænede fantasi for at selv at forestille sig, hvad det kan misbruges til.

AI kan ganske enkelt ikke kende forskel på ’er’ og ’forestiller’ og dermed heller ikke på sandt og falskt. For AI-systemerne er der ingen forskel. Iflg. en af mine venner giver det allerede problemer på uddannelser. Som han udtrykte det: ’Vores lokale universitetsbibliotek har ind i mellem et hyr med at finde ikke-eksisterende obskure artikler, som AI bare har opfundet, fordi det ligner…’

Så længe AI ikke kan se forskel på ’er’ og ’forestiller’ – som det Magritte i sin tid viste med sit billede af en pibe, så har man et alvorligt problem, hvis man tror, man kan hente sin viden eller det grundlæggende arbejde derfra. For det kan lige så godt være frit opfundet til lejligheden. Det forestiller kun. Og selvom ’det ved alle da’, kan jeg ikke se det i den måde, AI bliver brugt eller promoveret på. Man ’ved’ det godt, men det er ikke feset ind, at det faktisk, really, really er sådan.

Forstår ikke ‘ikke’

Oven i er der så det problem, at AI ikke forstår negationer. Og dem bruger vi faktisk tit på dansk. Som i juridisk som ‘ikke uden betydning’, ‘ikke uvæsentlige’ osv. Der bliver ‘ikke’ generelt smidt ud, dvs. AI leverer det stik modsatte, hvis du fx bruger AI til oversættelse. Hvis ikke du kender teksten indgående – fx fordi du selv skrev den – så har du ikke mange chancer for at opdage det, for teksten er flydende nok. Den skriver bare noget forkert. Meningsforvængende forkert. Der er ikke mange tekster, hvor ordet ‘ikke’ mangler helt. ‘Ikke’ er bare fjernet, og det gør som regel en markant forskel. Som at der står det modsatte af, hvad der skulle.

Kender ikke forskel på op og ned

AI har endnu en helt grundlæggende mangel – AI kan ikke opfatte rumligt, for AI har ingen sanser. Chat m.fl. forstår ikke højre, venstre, oppe, nede, bagved, foran… det har ikke noget at forstå med. Og det betyder, at hvis man fx vil placere en figur til højre i et billede, så kan man ikke regne med, det lykkes, uanset hvor mange gange, man forsøger. Det bliver som regel bare værre og værre. AI har af den grund et helt fundamentalt problem med forholdsord, da de generelt er rumlige i en eller anden forstand. Handler om hvor noget er i forhold til noget andet. Og der har AI ikke noget at forstå med. Så

Oversættelse – mjae…

Man kan let smide en tekst i ChatGPT og bede om en oversættelse. Det får man så i bidder, og hvis det er noget ligegyldigt – eller bedre endnu – en gang corporate bullshit, så går det såmænd nogenlunde, og ingen kan måske se forskel. Men forsøg ikke med litteratur, og hvis det betyder noget, hvem der gør hvad, så læs korrektur meget, meget grundigt. Dels kan du forvente, at hele sætninger eller afsnit mangler, eller at den digter løs selv – f.eks. tilføjer ‘sagde xx’ i dialoger, og får det 100% forkert. Hver gang. Eller man skriver en sætning som ‘Erik blev skudt af Ellen’, og der står ‘Erik shot Ellen’ i oversættelsen. Held og lykke med at få læseren til at forstå det plot.

Chat kan i det hele taget ikke helt finde ud af hvem der gør/siger hvad til/ved hvem. Oven i at skidtet så oversætter et ord ad gangen og ikke meningen, hvilket kan give nogle ret mærkværdige resultater og som regel forkerte. Som i pinligt forkerte. Og de er ikke engang ens forkerte. Oven i det kendte problem med negationer, hvor ‘det’ ik’ så ring’ endda’ bliver til ‘it’s rather bad’. Så med mindre man er bedre til begge sprog end AI og kan læse ultraskarp korrektur og kender teksten indgående, så skal man holde nallerne væk og finde en menneskelig oversætter. Bl.a. fordi fejloversættelser kan have konsekvenser. Som når der står i en manual til en elbil, at ladestikket skal renses med en luftpistol. (som jeg for sjov forsøgte at oversætte til engelsk, hvor den så oversatte luftpistol til blowtorch. Yup. For real. Fejlene er ikke bare sjove og hyggelige. Og skal vi gætte på, at det med luftpistolen også var pga. en AI-oversættelse?

Lyver så det driver

AI – som fx ChatGPT – er en mansplaining maskine, som bare ikke vil indrømme, hvis der er noget, den ikke ved. Så den finder bare på. Jeg havde et billede af en kirke, som jeg havde brug for at ville vide, hvor var, så jeg uploadede et foto af maleriet og spurgte ’hvilken kirke?’. Jeg tjekkede heldigvis de svar, jeg fik, for de var 100% forkerte og virkede som helt vilkårlige gætterier. Forslagene lignede ikke engang den kirke, der var på billedet. Og nej, der kom ikke en ‘jeg kan ikke genkende kirken på billedet’. Jeg forsøge måske 15 gange og fik 15 forkerte svar – jeg tjekker – og opgav og fandt ud af det på gammeldags vis vha. gæt og lokalarkiver. Hvor der var et foto af selvsamme maleri, som jeg brugte og oploadede. Som den altså ikke fandt.

AI stjæler

Jeg skulle også bruge noget om en en bestemt bygning i Paris, som jeg slog op på nettet og fandt en ret antik hjemmeside fra kvarteret i Paris, hvor jeg kunne se bygningsår, arkitekt osv., som var det, jeg havde brug for. Jeg spurgte meget kort efter Chat GPT om det samme – og fik et svar, som var direkte copy-paste af den franske hjemmesidetekst, jeg lige havde læst. Uden kildeangivelse.

Dummere end din kat

Noget af problemet skyldes måske, at generativ AI er dummere end din kat. I hvert fald iflg. Yann LeCun, (Vice-President, Chief AI Scientist at Meta and a professor at NYU and CIFAR), som han forklarede til Inga Strümke, (doktor i partikelfysik, forsker ved Institutt for datateknologi og informatikk ved Norges teknisk-naturvitenskapelige universitet (NTNU)) i Vetenskabens Värld (26.8.24.) på SVT2 om AI. Iflg Yann LeCun er generativ AI faktisk en blindgyde – i hvert fald når det drejer sig om at få AI til ligne menneskelig intelligens. AI forstår ingenting. AI kan ikke skabe selv. AI forstår ikke den fysiske verden – kan ikke planlægge, ikke ræsonnere, og som følge deraf ikke opfinde noget som helst. Vi og dyr har et mentalt billede af virkeligheden. Når vi er 9 mdr. ved vi fx, at hvis et objekt ikke holdes oppe af nogen eller noget, falder det ned. En 4-årig har været vågen ca. 16000 timer, og bare via de optiske never kommer 16 MB data per sekund igennem til bare den visuelle cortex. Det bliver til en hel del igennem livet, og sprog er en bittelille del af det sammenlignet med sensoriske indtryk.

Du skal kunne mere end AI

Du er nødt til selv at vide mere for overhovedet at kunne bedømme det, AI kommer med. Så hvis du er specialist på dit område, og lynhurtigt kan se, om kæden er hoppet af (eller det er så åbenbart som lastbiler i det gamle Palmyra), eller hvis output har basis i et kontrolleret datasæt, kan AI måske være udmærket værktøj. Hvis du fx har en agenda, hvor du skal bruge ’beviser’ for uholdbare eller forsætligt usande men økonomisk eller politisk fordelagtige påstande, er AI en total gavebod. Men ellers… Desværre er det nok ’ellers’, der er mest af.

AI er politisk

AI er præcis det, systemet får besked på. ChatGPT har tidligere vist sig at være både misogyn og racistisk, og man kan kun gætte på, hvor galt det bliver. Når man på forhånd ved, at AI digter løs, kan man kun frygte for fremtiden. AI er det perfekte værktøj til gaslighting, hvor man i svarene, formuleringerne… alt, kan fremme politiske ideer, undlade at oplyse om personer, man ikke ønsker, nogen skal kende – ganske som mænd før i tiden helt forsætligt udelod kvindelige forskere, forfattere, kunstnere osv. Her bliver det næppe kun kvinder men også alle andre, som ikke passer til den idiologi, som ønskes fremmet.

Det er i min optik totalt udelukket at bruge AI i undervisning, når man på forhånd ved, at de svar, eleverne får, er udvalgt til at passe til en bestemt politisk ideologi. Det er subtil opdragelse af alle til at gøre og vide, hvad en ganske lille bitte gruppe superrige vil have os til at tro, så vi ser op til dem i stedet for at se igennem deres bedrag. Og det vil 100% sikkert blive meget værre. Og sikkert også mindre og mindre subtilt, som vi bliver desentizied og bare tager det for ’the new normal’. Et skred man allerede tydeligt kan se. Svar som skal forestille viden men som reelt er propaganda, så Honecker må blive lilla af misundelse i sin grav. Nu kan vi så vælge mellem amerikansk og kinesisk manipulation.

AI er lige så troværdigt som dette portræt af mig

og et PS fra 9.2.26. Nogle er begyndt at bruge AI i operationer. Det har resulteret invaliderende fejloperationer.

Anduin